Trendul caricaturilor create cu ajutorul inteligenței artificiale – care ilustrează într-o imagine colorată tot ceea ce un chatbot „știe” despre o persoană – poate implica riscuri serioase de securitate, potrivit experților în cybersecurity, relatează Euronews.

Utilizatorii încarcă o fotografie cu ei înșiși, alături de logo-ul companiei sau detalii despre rolul lor profesional, și cer ChatGPT-ului dezvoltat de OpenAI să genereze o caricatură care să îi reprezinte, folosind informațiile pe care chatbotul le deține despre ei.

Experții în securitate cibernetică au declarat că astfel de provocări de pe rețelele sociale, precum caricaturile AI, pot oferi infractorilor o cantitate considerabilă de informații valoroase. O singură imagine, combinată cu date personale, poate dezvălui mai mult decât își dau seama utilizatorii.

„Le faceți munca escrocilor – le oferiți o reprezentare vizuală a cine sunteți”, a declarat Bob Long, vicepreședinte al companiei Daon, specializată în autentificarea vârstei.

Formularea în sine a provocării ar trebui să ridice semne de întrebare, a adăugat el, pentru că „sună ca și cum ar fi fost inițiată intenționat de un fraudator care vrea să își ușureze munca”.

Ce se întâmplă cu imaginile după ce sunt încărcate?

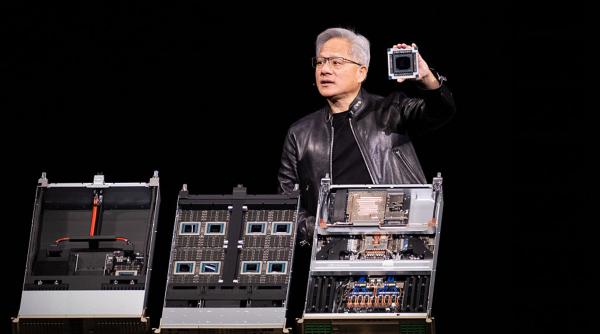

Atunci când un utilizator încarcă o imagine într-un chatbot AI, sistemul procesează fotografia pentru a extrage date precum emoțiile persoanei, mediul în care se află sau informații care ar putea dezvălui locația acesteia, potrivit consultantului în securitate cibernetică Jake Moore. Aceste informații pot fi apoi stocate pentru o perioadă de timp necunoscută.

Bob Long a afirmat că imaginile colectate de la utilizatori pot fi utilizate și păstrate pentru antrenarea generatoarelor de imagini AI, ca parte a seturilor lor de date.

O eventuală breșă de securitate la o companie precum OpenAI ar putea însemna că date sensibile – inclusiv imaginile încărcate și informațiile personale colectate de chatbot – ajung în posesia unor actori rău intenționați, care le-ar putea exploata.

În mâini greșite, o singură imagine de înaltă rezoluție ar putea fi folosită pentru a crea conturi false pe rețelele sociale sau deepfake-uri realiste generate cu AI, utilizate ulterior în escrocherii, a avertizat Charlotte Wilson, director enterprise la Check Point, companie israeliană de securitate cibernetică.

„Selfie-urile îi ajută pe infractori să treacă de la fraude generice la impersonări personalizate, extrem de convingătoare”, a spus ea.

Setările de confidențialitate ale OpenAI menționează că imaginile încărcate pot fi utilizate pentru îmbunătățirea modelului, inclusiv pentru antrenarea acestuia. Întrebat despre aceste setări, ChatGPT a precizat că acest lucru nu înseamnă că fiecare fotografie este plasată într-o bază de date publică.

În schimb, chatbotul a explicat că utilizează tipare din conținutul utilizatorilor pentru a rafina modul în care sistemul generează imagini.

Ce ar trebui să faci dacă vrei să participi la trendurile AI

Pentru cei care doresc totuși să participe la astfel de trenduri, experții recomandă limitarea informațiilor partajate.

Charlotte Wilson a spus că utilizatorii ar trebui să evite încărcarea imaginilor care dezvăluie informații identificabile.

„Decupați strâns fotografia, păstrați un fundal simplu și nu includeți ecusoane, uniforme, legitimații de serviciu, indicii despre locație sau orice alt element care vă leagă de un angajator sau de o rutină”, a explicat ea.

Wilson a avertizat, de asemenea, asupra tendinței de a oferi prea multe detalii în prompturi, precum funcția, orașul sau numele angajatorului.

La rândul său, Jake Moore recomandă verificarea setărilor de confidențialitate înainte de a participa, inclusiv opțiunea de a exclude datele din procesul de antrenare AI.

OpenAI pune la dispoziție un portal de confidențialitate care permite utilizatorilor să opteze pentru excluderea conținutului lor din antrenarea modelelor AI, prin selectarea opțiunii „do not train on my content”.

Utilizatorii pot, de asemenea, dezactiva antrenarea pe baza conversațiilor text cu ChatGPT prin oprirea opțiunii „improve the model for everyone”.

În temeiul legislației UE, utilizatorii pot solicita ștergerea datelor personale colectate de companie. Totuși, OpenAI precizează că poate păstra anumite informații chiar și după ștergere, pentru a preveni fraudele, abuzurile sau riscurile de securitate.